Жасанды интеллектіні қолдану бүгінде таңдау емес, қажеттілікке айналды. Күнделікті хат жазудан бастап күрделі есептерді талдауға дейінгі процестерде нейрожелілердің көмегіне жүгіну – қалыпты тәжірибе. Бірақ технология кең тараған сайын оған деген сенім мен күмән қатар өсіп келеді. Соңғы жылдары жасанды интеллектке қатысты құқықтық, этикалық және қауіпсіздік мәселелері бұрын-соңды болмаған деңгейде талқылана бастады, деп жазады Ozgeris.info.

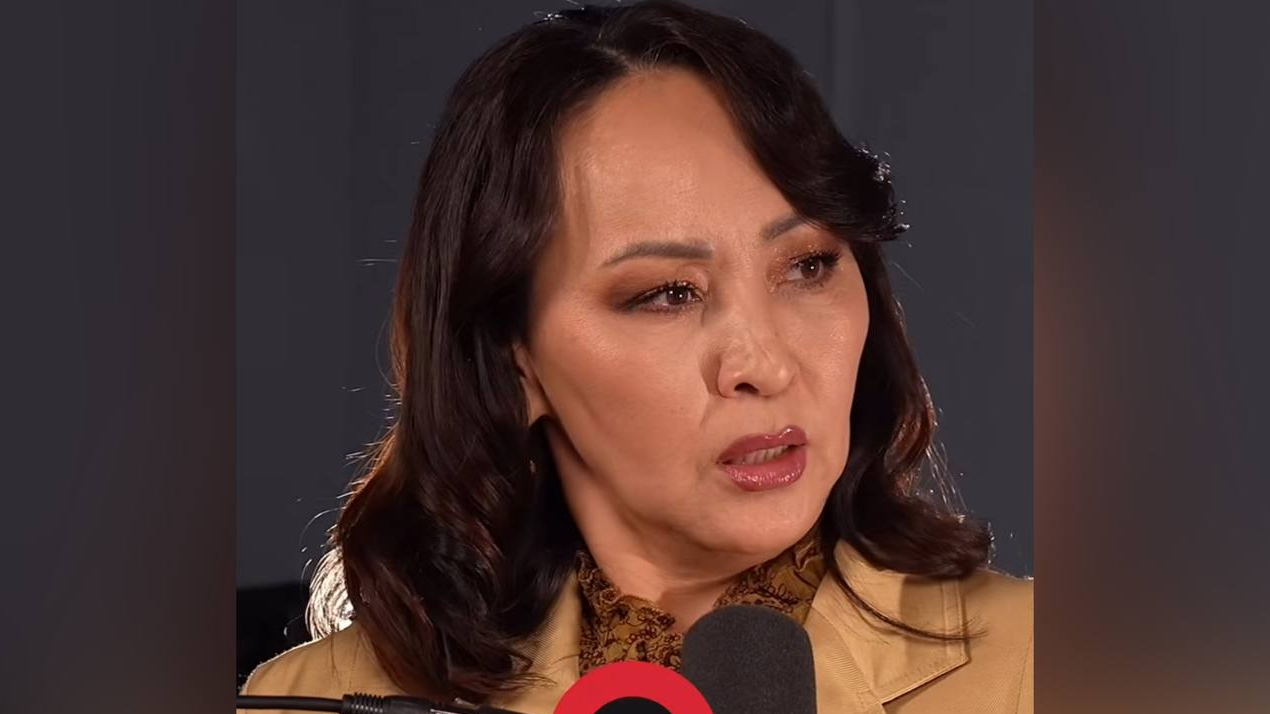

Басты сұрақ өзгерді: енді қоғам «жасанды интеллект не істей алады?» деп емес, «оның салдары қандай болады?» деп ойланатын кезеңге өтті. Жақында халықаралық деңгейде резонанс тудырған оқиға осы күмәннің қаншалықты негізді екенін көрсетті. Мемлекеттік құрылымдар ресми есеп дайындау барысында нейрожеліні қолданғаны үшін аудит барысында сынға ұшырады. Тексеру нәтижесінде есеп ішіндегі кейбір деректер мен сілтемелердің шынайы емес екені анықталды. Бұл жағдай тек техникалық қателік ретінде емес, институционалдық сенімге нұқсан келтіретін фактор ретінде бағаланды. Егер мұндай мәліметтер тексерусіз қабылданғанда, жалған ақпарат ресми құжат деңгейінде бекітілуі мүмкін еді.

Ғылыми ортада бұл құбылыс «AI hallucination» деп аталады. Яғни, жасанды интеллект нақты дерекке сүйенбей, ықтималдыққа негізделген жауап береді. Мұндай жағдайда мәтін логикалық тұрғыда дұрыс көрінуі мүмкін, бірақ оның мазмұны шындыққа сәйкес келмеуі ықтимал. MIT Technology Review сарапшылары генеративті модельдердің басты әлсіздігі дәл осы екенін атап өтеді. Ал Stanford University зерттеулері пайдаланушылардың басым бөлігі нейрожелі ұсынған ақпаратты тексермей қабылдайтынын көрсеткен.

Алайда қауіп тек ақпараттың сапасымен шектелмейді. Киберқауіпсіздік тұрғысынан алғанда ең әлсіз тұс деректердің құпиялығы. Көптеген қолданушы жасанды интеллектпен жұмыс істеуді жеке, жабық кеңістік ретінде қабылдайды. Шын мәнінде, бұл сыртқы серверлерге тәуелді ашық экожүйе.

OpenAI, Google, xAI секілді платформалардың барлығы деректерді бұлттық инфрақұрылымда сақтайды. Бұл дегеніміз – енгізілген ақпараттың толық қауіпсіздігіне кепілдік жоқ.

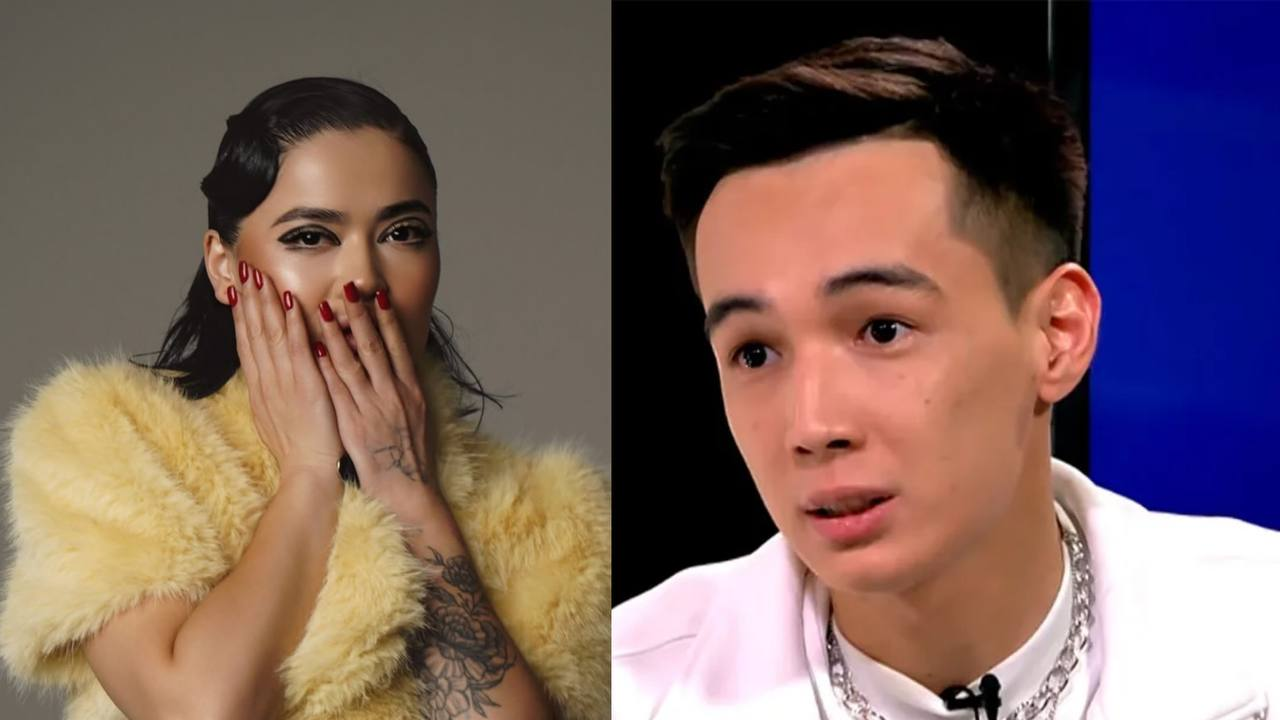

Кейбір елдерде бұл мәселе заң деңгейінде қарастырылып жатыр. Мысалы, мемлекеттік қызметкерлердің құпия ақпаратты шетелдік сервистерге жүктеуіне шектеу қойылған. Осындай талаптарды бұзған жағдайлар тіркеліп, қызметтік жауапкершілікке дейін жеткен мысалдар бар. Соңғы жылдары деректердің сыртқа таралуына байланысты бірнеше шулы оқиға болды. Мәселен, кейбір платформаларда пайдаланушылардың жеке диалогтері іздеу жүйелерінде ашық түрде пайда болған.

Тағы бір белгілі жағдай Samsung компаниясында тіркелді. Қызметкерлер бағдарламалық кодты тексеру үшін нейрожеліні пайдаланған. Нәтижесінде бұл деректер кейін жүйенің басқа жауаптарында көрініс тапқан. Мұндай жағдайда ақпараттың нақты қайда кеткенін немесе кім пайдаланғанын анықтау іс жүзінде мүмкін емес.

Жасанды интеллект жүйелерінің басым бөлігі пайдаланушылар енгізген деректер арқылы жетілдіріледі. Кез келген мәтін, құжат немесе сұрақ – модельді оқытатын ресурсқа айналады. Бұл өз кезегінде «тегін сервис» ұғымының шартты екенін көрсетеді.

World Economic Forum деректерді «жаңа мұнай» деп сипаттай отырып, цифрлық экономикадағы негізгі ресурс ретінде ақпаратты атап өтеді. Пайдаланушы жүйені пайдаланып отырған жоқ, белгілі бір деңгейде жүйе де пайдаланушыны пайдаланып отыр деуге болады.

Осы тұста негізгі қауіп – адамдардың жасанды интеллектіні абсолют сенім көзі ретінде қабылдауы. Нейрожелі тек көмекші құрал болғанымен, көп жағдайда оның жауабы дайын шешім ретінде қарастырылады.

Сарапшылар бірнеше қарапайым, бірақ маңызды қағиданы атап өтеді. Біріншіден, жасанды интеллектіге ешқашан құпия ақпарат жүктелмеуі тиіс. Келісімшарттар, жеке деректер, банк реквизиттері немесе ішкі қызметтік ақпарат сыртқы жүйеге берілмеуі қажет. Екіншіден, алынған ақпарат міндетті түрде тексерілуі керек. Үшіншіден, нейрожелі автор емес, тек құрал ретінде қабылдануы тиіс.

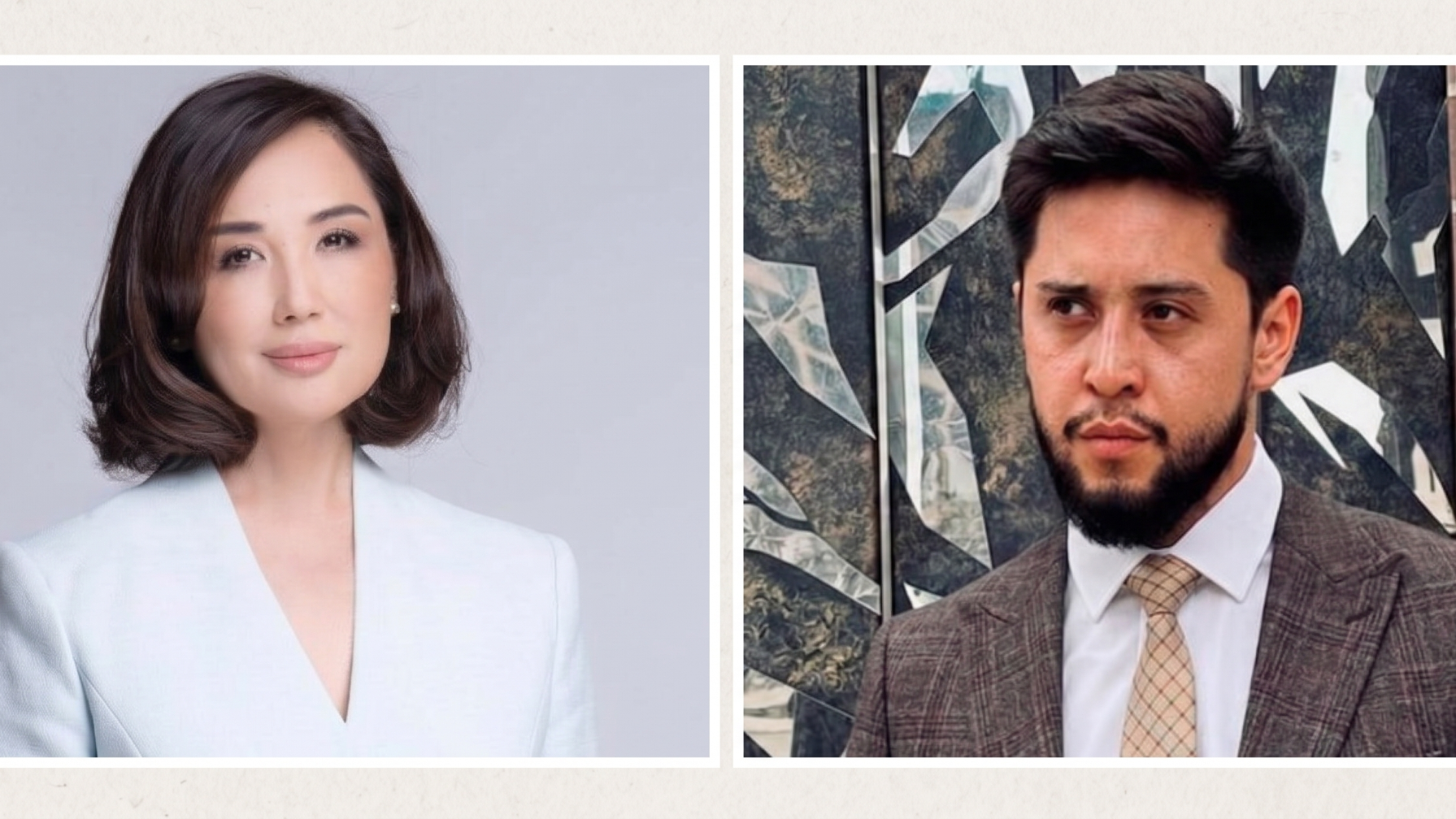

Осы мәселе тек жеке қауіпсіздік деңгейінде ғана емес, құқықтық кеңістікте де өзекті. Әлемде жасанды интеллектіні реттеу бағытында түрлі модельдер қалыптасып жатыр. European Union қабылдаған AI Act заңы тәуекелге негізделген тәсілді енгізіп, кейбір технологияларға тікелей тыйым салды. Атап айтқанда, әлеуметтік скоринг, адамның мінез-құлқын жасырын бақылау, эмоцияны келісімсіз талдау сияқты жүйелер заңсыз деп танылды.

Қазақстан да бұл бағытта белсенді саясат жүргізіп отыр. Жаңа қабылданған «Жасанды интеллект туралы» заң қауіпсіздік пен адам құқықтарын қорғауды басты басымдық ретінде айқындайды. Заң аясында технологиялар тәуекел деңгейіне қарай жіктеліп, синтетикалық контентті белгілеу міндеті енгізілген.

Сонымен қатар деректер қауіпсіздігіне қатысты талаптар күшейтіліп, ақпараттың қайда сақталатыны, оған кімнің қол жеткізе алатыны нақты регламенттелген. Бұл тек жасанды интеллектіні емес, жалпы цифрлық экожүйені бақылауға бағытталған жүйелі саясаттың белгісі.

Жалпы алғанда, жасанды интеллект қауіпті технология емес. Қауіп оны қолдану мәдениетінде жатыр. Harvard University зерттеушілері жасанды интеллектіні «decision-support tool» ретінде қарастыру керек екенін айтады. Яғни ол шешім қабылдамайды, тек ұсыныс береді.

Сондықтан жауапкершілік өзгермейді:

· шешімді – адам қабылдайды,

· қателіктің салдарын – адам көтереді.

Демек жасанды интеллектіні қолдану қауіпсіз бе деген сұрақтың жауабы біржақты емес. Ол қауіпсіз де, қауіпті де болуы мүмкін. Барлығы оны қалай, қандай мақсатта және қандай деңгейде қолданатынымызға байланысты.